近期发布的Qwen3-4B新模型性能大幅提升。在非推理(non-thinking)领域,Qwen3-4B-Instruct-2507 全面超越了闭源的 GPT4.1-Nano;在推理(thinking)领域,Qwen3-4B-Thinking-2507 甚至可以媲美中等规模的 Qwen3-30B-A3B(thinking)。

正是这种高速小尺寸模型,让实时AI翻译成为非常有用的一个功能。

Chrome翻译插件:沙拉翻译是非常常用的工具,最近的版本新增了AI翻译的功能,提供各种AI平台的接口,如OpenAI,Gemini,Claude,DeepSeek,通义千问等。要使用以上平台都需要注册账号并开启API功能,费用按量结算。

我们通过LM-Studio本地部署Qwen3-4B-Instruct-2507,搭配沙拉翻译实现超快实时web内容选段翻译,完全免费。

首先安装LM-Studio,下载地址:https://lmstudio.ai/ ,根据自己的显卡选择适合的引擎。

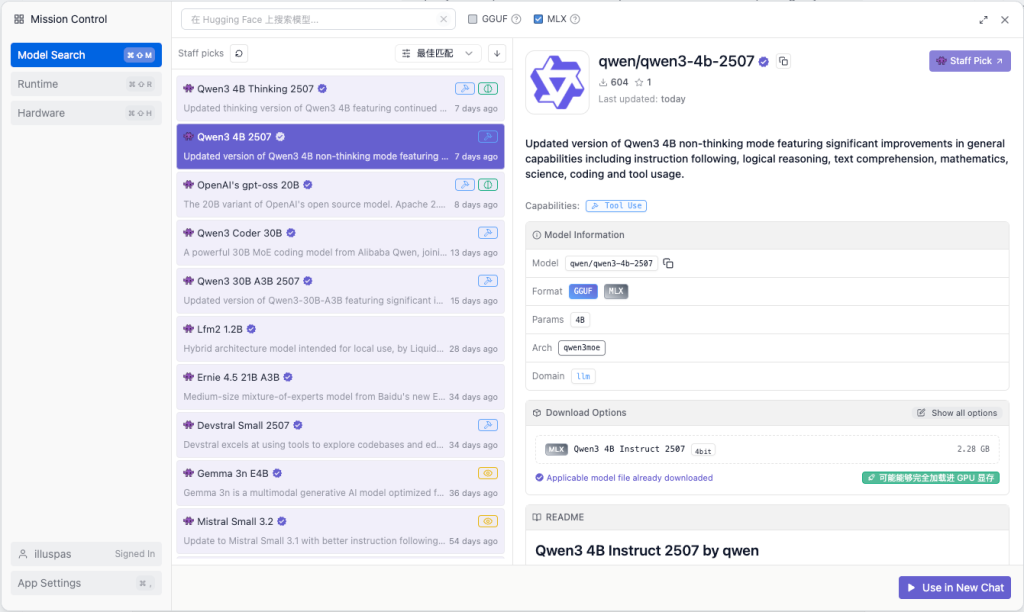

下载模型Qwen3 4B 2507,注意不要选到Thinking了,我们这里的实时翻译不需要推理过程。

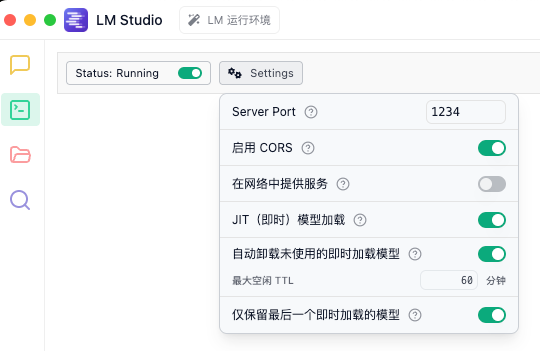

点击LM Studio的开发者标签页,打开并设置:

接下来是浏览器安装插件, 访问沙拉翻译:https://saladict.aichatone.com/zh-CN,选择下载chrome或edge,安装好之后,在插件上点右键选择“选项”,先进入词典账号选项,设置通义千问的选项。

baseUrl: http://127.0.0.1:1234/v1

model: qwen/qwen3-4b-2507

最后,进入词典设置页面, 删除全部的词典只保留通义千问。

实际翻译体验:翻译结果非常准确,速度相当快!注:首次翻译时会自动加载模型,这一步会有延迟,当然也可以先在lm-studio中加载模型。

原创文章,转载请注明: 转载自诺德美地科技

本文链接地址: Qwen3-4B-Instruct-2507 应用–快速AI翻译